Погрешности измерительных приборов

Содержание:

- Введение

- Пределы

- Максимальная абсолютная погрешность

- Что такое класс точности манометра, и как его определить

- Определение погрешности

- Пример 2

- Учимся определять погрешность взвешивания

- Что означает погрешность

- 30 Поверка и калибровка си. Определения. Правовые основы.

- ВЕСА РЕЗУЛЬТАТОВ НЕРАВНОТОЧНЫХ ИЗМЕРЕНИЙ

- Абсолютная погрешность — измерительный прибор

Введение

Разберемся в значении понятия «измерить величину». Процесс измерения заключается в том, чтобы сравнить её с однородными величинами, которые принимают в качестве единицы.

Для определения объёма используются литры, для вычисления массы применяются граммы. Чтобы было удобнее производить расчеты, ввели систему СИ международной классификации единиц.

За измерение длины вязли метры, массы – килограммы, объёма – кубические литры, времени – секунды, скорости – метры за секунду.

При вычислении физических величин не всегда нужно пользоваться традиционным способом, достаточно применить вычисление при помощи формулы. К примеру, для вычисления таких показателей, как средняя скорость, необходимо поделить пройденное расстояние на время, проведенное в пути. Так производятся вычисления средней скорости.

Применяя единицы измерения, которые в десять, сто, тысячу раз превышают показатели принятых измерительных единиц, их называют кратными.

Наименование каждой приставки соответствует своему числу множителя:

- Дека.

- Гекто.

- Кило.

- Мега.

- Гига.

- Тера.

В физической науке для записи таких множителей используется степень числа 10. К примеру, миллион обозначается как 106.

В простой линейке длина имеет единицу измерения – сантиметр. Она в 100 раз меньше метра. 15-сантиметровая линейка имеет длину 0,15 м.

Линейка является простейшим видом измерительных приборов для того, чтобы измерять показатели длины. Более сложные приборы представлены термометром – чтобы измерять температуру, гигрометром – чтобы определять влажность, амперметром – замерять уровень силы, с которой распространяется электрический ток.

Пределы

Как уже говорилось раньше, измерительный прибор, благодаря нормированию уже содержит случайную и систематические ошибки. Но стоит помнить, что они зависят от метода измерения, условий и других факторов. Чтобы значение величины, подлежащей замеру, было на 99% точным, средство измерения должно иметь минимальную неточность. Относительная должна быть примерно на треть или четверть меньше погрешности измерений.

Базовый способ определения погрешности

При установке класса точности в первую очередь нормированию подлежат пределы допустимой основной погрешности, а пределы допускаемой дополнительной погрешности имеют кратное значение от основной. Их пределы выражают в форме абсолютной, относительной и приведенной.

Приведенная погрешность средства измерения – это относительная, выраженная отношением предельно-допустимой абсолютной погрешности к нормирующему показателю. Абсолютная может быть выражена в виде числа или двучлена.

Если класс точности СИ будет определяться через абсолютную, то его обозначают римскими цифрами или буквами латиницы. Чем ближе буква будет к началу алфавита, тем меньше допускаемая абсолютная погрешность такого аппарата.

Класс точности 2,5

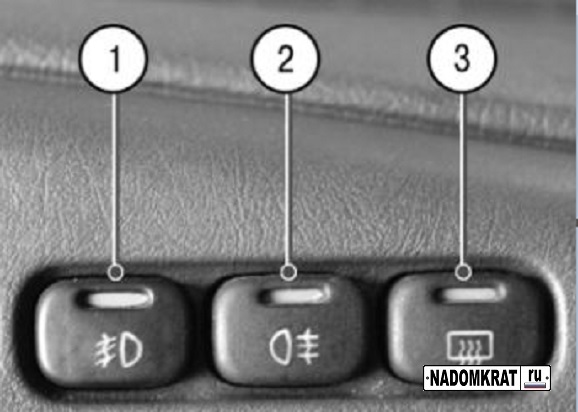

Благодаря относительной погрешности можно назначить класс точности двумя способами. В первом случае на шкале будет изображена арабская цифра в кружке, во втором случае дробью, числитель и знаменатель которой сообщают диапазон неточностей.

Основная погрешность может быть только в идеальных лабораторных условиях. В жизни приходится умножать данные на ряд специальных коэффициентов.

Дополнительная случается в результате изменений величин, которые каким-либо образом влияют на измерения (например температура или влажность). Выход за установленные пределы можно выявить, если сложить все дополнительные погрешности.

Случайные ошибки имеют непредсказуемые значения в результате того, что факторы, оказывающие на них влияние постоянно меняются во времени. Для их учета пользуются теорией вероятности из высшей математики и ведут записи происходивших раньше случаев.

Пример расчета погрешности

Статистическая измерительного средства учитывается при измерении какой-либо константы или же редко подверженной изменениям величины.

Динамическая учитывается при замерах величин, которые часто меняют свои значения за небольшой отрезок времени.

Максимальная абсолютная погрешность

|

Процесс зфавновсшивагия в цифровых приборах развертывающего уравновеши. |

В цифровых циклических приборах выходной код N приближается к искомому отсчету Nх с одной стороны, сверху или снизу, поэтому при АХп ч 0 максимальная абсолютная погрешность от квантования равна ступени & хк.

Здесь: Арн — максимальная абсолютная погрешность величины рн, равная половине единицы разряда последней значащей цифры в табличном значении рн; Ар и АГ — максимальные абсолютные погрешности измерения р и Т соответственно.

Абсолютная погрешность температурного предела смеси при использовании в расчете надежных экспериментальных данных по давлению пара чистых компонентов, растворимости и коэффициентам активности, как правило, не превышает максимальной абсолютной погрешности температурного предела компонентов смеси.

Абсолютная погрешность при изображении в ячейке чисел с запятой, фиксированной после определенного разряда, не превосходит по величине единицы младшего разряда, то есть, как говорят, максимальная абсолютная погрешность при этом постоянна. https://spb-evacuator.ru.

Для учета в модели однократной экстракции NRTL влияния воды, были дополнительно подобраны эмпирические коэффициенты бинарного взаимодействия воды с компонентами системы, применение которых при численных исследованиях существенно уменьшило погрешности моделирования в области содержания воды в экстрагенте выше 8 % об. По выходу рафината и содержанию в нем аренов максимальные абсолютные погрешности в этой области составляют 0 6 и 0 9 %, соответственно. Погрешности расчета по выходу экстракта и содержания в нем аренов снизились до 0 6 и 1 1 %, что составляет 4 8 и 1 4 % относительной по.

Следует отметить, что для измерения среднего фазового сдвига рассмотренным методом характерно уменьшение погрешности дискретности по сравнению с имеющей место при измерении одиночного интервала времени. Хотя максимальная абсолютная погрешность дискретности определения длительности одного интервала АГ составляет ГСЧ, результирующая погрешность за время измерения Ткзм уменьшается, так как результаты измерения всех k интервалов АГ суммируются, а возникновение частотной погрешности дискретности положительного или отрицательного знака равновероятно.

Рассмотрим погрешность от квантования. Следовательно, максимальная абсолютная погрешность от квантования будет равна единице.

Второй способ сводится к увеличению числа импульсов, заполняющих временные ворота, достигаемому умножением частоты исследуемого сигнала. При этом максимальная абсолютная погрешность меняется ( если неизменна длительность ворот), но уменьшается относительная погрешность. Осуществление данного способа сопряжено с применением дополнительного блока — умножителя частоты, что усложняет и удорожает аппаратуру.

Максимальную погрешность Дгд Т0 удобно учитывать через эквивалентное случайное изменение числа счетных импульсов Nx на 1 импульс. При этом максимальная абсолютная погрешность дискретизации может быть определена разностью значений частоты / получаемых по формулам (7.4) или (7.5) при Л 1 и Nx, и равна А.

Максимальные абсолютные погрешности показаний манометров Мп и Мв, исправленных на систематические погрешности приборов, принимаются равными 0 2н — 0 5 цены наименьшего деления шкалы, если эта величина не превышает вариации показаний прибора. В противном случае максимальная абсолютная погрешность равна вариации показа ний прибора, которая определяется при тарировании.

Максимальные абсолютные погрешности показаний манометров М и Мв, исправленных на систематические погрешности приборов, принимаются равными 0 2 — 0 5 цены наименьшего деления шкалы, если эта величина не превышает вариации показаний прибора. В ином случае максимальная абсолютная погрешность будет равна вариации показаний прибора, которая определяется при тарировании.

|

Вид кривой У 10 — 4Х2 и ее аппроксимация линейными отрезками. |

Точность результата зависит от того, в каком состоянии находится счетчик-интегратор в момент остановки цикла вычисления. Для этого значения получаем максимальную абсолютную погрешность — 5 импульсов младшего разряда.

Например, при отсчете или установке визира на логарифмической линейке длиной 250 мм ошибка не превышает 0 1 мм. Таким образом, обычно бывает известна максимальная абсолютная погрешность, получаемая при измерении величины х; обозначим эту погрешность через их.

Что такое класс точности манометра, и как его определить

Класс точности манометра является одной из основных величин, характеризующих прибор. Это процентное выражение максимально допустимая погрешность измерителя, приведенная к его диапазону измерений.

Абсолютная погрешность представляет собой величину, которая характеризует отклонение показаний измерительного прибора от действительного значения давления. Также выделяют основную допустимую погрешность, которая представляет собой процентное выражение абсолютного допустимого значения отклонения от номинального значения. Именно с этой величиной связан класс точности.

Существует два типа измерителей давления — рабочие и образцовые.

Рабочие применяются для практического измерения давления в трубопроводах и оборудовании. Образцовые — специальные измерители, которые служат для поверки показаний рабочих приборов и позволяют оценить степень их отклонения. Соответственно, образцовые манометры имеют минимальный класс точности.

Классы точности современных манометров регламентируются в соответствии с ГОСТ 2405-88 Они могут принимать следующие значения:

Таким образом, этот показатель имеет прямую зависимость с погрешностью. Чем он ниже, тем ниже максимальное отклонение, которое может давать измеритель давления, и наоборот. Соответственно, от этого параметра зависит, насколько точными являются показания измерителя. Высокое значение указывает на меньшую точность измерений, а низкое соответствует повышенной точности. Чем ниже значение класса точности, тем более высокой является цена устройства.

Узнать этот параметр достаточно просто. Он указан на шкале в виде числового значения, перед которым размещаются литеры KL или CL. Значение указывается ниже последнего деления шкалы.

Указанная на приборе величина является номинальной. Чтобы определить фактический класс точности, нужно выполнить поверку и рассчитать его. Для этого проводят несколько измерений давления образцовым и рабочим манометром. После этого необходимо сравнить показания обоих измерителей, выявить максимальное фактическое отклонение. Затем остается только посчитать процент отклонения от диапазона измерений прибора.

Определение погрешности

Владельцев измерительных приборов интересует, прежде всего, величина максимальной погрешности, характерной для манометра. Она зависит не только от класса точности, но и от диапазона измерений. Таким образом, чтобы получить значение погрешности, нужно произвести некоторые вычисления. Например, для манометра с диапазоном измерений, равным 6 МПа, и классом точности 1,5 погрешность будет рассчитываться по формуле 6*1,5/100=0,09 МПа.

Необходимо отметить, что таким способом можно посчитать только основную погрешность.

Ее величина определяется идеальными условиями эксплуатации. На нее оказывают влияние только конструктивные характеристики, а также особенности сборки прибора, например, точность градуировки делений на шкале, сила трения в измерительном механизме. Однако эта величина может отличаться от фактической, поскольку существует также дополнительная погрешность, определяемая условиями, в которых эксплуатируется манометр. На нее может влиять вибрация трубопровода или оборудования, температура, уровень влажности и другие параметры.

Также точность измерения давления зависит от еще одной характеристики манометра — величины его вариации, которую определяют в ходе поверки. Это максимальная разница показаний измерителя, выявленная по результатам нескольких измерений.

Величина вариации в значительной мере зависит от конструкции манометра, а именно от способа уравновешивания, которое может быть жидкостным (давлением столба жидкости) или механическим (пружиной). Механические манометры имеют более выраженную вариацию, что часто обусловлено дополнительным трением при плохой смазке или износе деталей, потере упругости пружины и другими факторами.

Пример 2

Если речь идет не просто о подсчетах событий, а об измерении непрерывной величины, то там статистическая погрешность тоже присутствует, но вычисляется она чуть сложнее.

Предположим, вы хотите измерить массу какой-то новой, только что открытой частицы. Частица эта рождается редко, и у вас из всей статистики набралось лишь четыре события рождения этой частицы. В каждом событии вы измерили ее массу, и у вас получилось четыре результата (мы здесь намеренно опускаем возможные систематические погрешности): 755 МэВ, 805 МэВ, 770 МэВ, 730 МэВ. Теперь можно взять область масс от 700 до 850 МэВ и поставить на ней эти четыре точки (рис. 1). Поскольку каждая точка отвечает одному событию с данной массой, мы каждой точке присваиваем погрешность ±1 событие. То, что массы разные, — совершенно нормально, поскольку у нестабильных частиц есть некая «размазка» по массе. Поэтому, согласно теории, ожидается некая плавная кривая, и когда физики говорят про массу нестабильной частицы, они имеют в виду положение максимума этой кривой. Она тоже показана на рис. 1, но только положение и ширина этой кривой заранее неизвестны, они определяются по наилучшему соответствию с данными.

Из-за того что данных очень мало, мы можем провести эту кривую так, как показано на рисунке, а можем и немножко сместить ее в стороны — и так, и эдак будет осмысленное совпадение. Вычислив среднее значение массы, можно получить положение пика этой кривой, а также его неопределенность: 765 ± 15 МэВ. Эта неопределенность целиком и полностью обязана разным результатам измерений, она и является статистической погрешностью измерения.

Учимся определять погрешность взвешивания

Это один из примеров прямых измерений. На особом месте стоит взвешивание. Ведь у рычажных весов нет шкалы. Научимся определять погрешность такого процесса. На точность измерения массы влияет точность гирь и совершенство самих весов.

Мы пользуемся рычажными весами с набором гирь, которые необходимо класть именно на правую чашу весов. Для взвешивания возьмем линейку.

Перед началом опыта нужно уравновесить весы. Линейку кладем на левую чашу.

Масса будет равна сумме установленных гирь. Определим погрешность измерения этой величины.

D m = D m (весов) + D m (гирь)

Погрешность измерения массы складывается из двух слагаемых, связанных с весами и гирями. Чтобы узнать каждую из этих величин, на заводах по выпуску весов и гирь продукция снабжается специальными документами, которые позволяют вычислить точность.

Что означает погрешность

Стандартный вид записи измеренной величины с погрешностью знаком всем. Например, результат взвешивания какого-то предмета может быть 100 ± 5 грамм. Это означает, что мы не знаем абсолютно точно массу, она может быть и 101 грамм, и 96 грамм, а может быть и все 108 грамм. Но уж точно не 60 и не 160 грамм. Мы говорим лишь, сколько нам показывают весы, и из каких-то соображений определяем тот примерный разброс, который измерение вполне могло бы дать.

Тут надо подчеркнуть две вещи. Во-первых, в бытовой ситуации значение 100 ± 5 грамм часто интерпретируется так, словно истинная масса гарантированно лежит в этом диапазоне и ни в коей мере не может быть 94 или 106 грамм. Научная запись подразумевает не это. Она означает, что истинная масса скорее всего лежит в этом интервале, но в принципе может случиться и так, что она немножко выходит за его пределы. Это становится наиболее четко, когда речь идет о статистических погрешностях; см. подробности на страничке Что такое «сигма»?.

Во-вторых, надо четко понимать, что погрешности — это не ошибки эксперимента. Наоборот, они являются показателем качества эксперимента. Погрешности характеризуют объективный уровень несовершенства прибора или неидеальности методики обработки. Их нельзя полностью устранить, но зато можно сказать, в каких рамках результату можно доверять.

Некоторые дополнительные тонкости, связанные с тем, что именно означают погрешности, описаны на странице Тонкости анализа данных.

30 Поверка и калибровка си. Определения. Правовые основы.

В

соответствии с законом РК «Об обеспечении

единства измерений» введены следующие

понятия:

— поверка

средства измерений —

совокупность операций, выполняемых

органами Государственной метрологической

службы (другими уполномоченными на то

органами, организациями) с целью

определения и подтверждения соответствия

средства измерений установленным

требованиям;

— калибровка

средств измерений —

совокупность операций, выполняемых с

целью определения и подтверждения

действительных значений метрологических

характеристик и/или пригодности к

применению средства измерений, не

подлежащего государственному

метрологическому контролю и надзору.

В

обоих случаях, как при поверке, так и

при калибровке, определяются метрологические

характеристики средств измерений,

причем часто по одной и той же методике,

называемой методикой

поверки,

но на этом их сходство заканчивается. Различия

между этими понятиями имеют

более принципиальный характер.

Во-первых,

в сферах распространения ГМКиН могут

применяться только поверенные СИ, а

калиброванные — не могут.

Во-вторых,

поверке могут подвергаться только СИ

утвержденного типа, то есть внесенные

в Государственный реестр СИ, а калибровке

— любые, в том числе нестандартизованные

и изготовленные в одном экземпляре.

В-третьих,

при поверке проверяется соответствие

СИ своему типу, внесенному в Государственный

реестр, тогда как при калибровке

определяются действительные

метрологические характеристики, которые

прибор имеет на момент калибровки.

Если

при поверке СИ обнаружено его несоответствие

хотя бы одному пункту утвержденного

типа, средство измерений должно быть

забраковано. При калибровке этому СИ

будут приписаны новые значения

метрологических характеристик.

Положительные

результаты поверки удостоверяются

поверительным клеймом или свидетельством

о поверке. Если средство измерений по

результатам поверки признано непригодным

к применению, оттиск поверительного

клейма и свидетельство о поверке

аннулируются и выписывается извещение

о непригодности или делаются соответствующие

записи в технической документации.

Результаты

калибровки удостоверяются калибровочным

знаком (клеймом), наносимым на средство

измерений, или сертификатом о калибровке,

а также, записью в эксплуатационных

документах. В соответствии с законом

РК «Об обеспечении единства измерений»

калибровка средств измерений является

процедурой добровольной и осуществляемой

по желанию владельца прибора с целью,

например, получения достоверных

результатов измерений, влияющих, в

конечном счете, на результаты труда.

ГМКиН на такие средства измерений не

распространяется.

ВЕСА РЕЗУЛЬТАТОВ НЕРАВНОТОЧНЫХ ИЗМЕРЕНИЙ

При неравноточных измерениях, когда результаты каждого измерения нельзя считать одинаково надежными, уже нельзя обойтись определением простого арифметического среднего. В таких случаях учитывают достоинство (или надежность) каждого результата измерений.Достоинство результатов измерений выражают некоторым числом, называемым весом этого измерения. Очевидно, что арифметическое среднее будет иметь больший вес по сравнению с единичным измерением, а измерения, выполненные при использовании более совершенного и точного прибора, будут иметь большую степень доверия, чем те же измерения, выполненные прибором менее точным.

Поскольку условия измерений определяют различную величину средней квадратической погрешности, то последнюю и принято принимать в качестве основы оценки весовых значений, проводимых измерений. При этом веса результатов измерений принимают обратно пропорциональными квадратам соответствующих им средних квадратических погрешностей.

Так, если обозначить через р и Р веса измерений, имеющие средние квадратические погрешности соответственно m и µ, то можно записать соотношение пропорциональности:

Например, если µ средняя квадратическая погрешность арифметического среднего, а m – соответственно, одного измерения, то, как следует из

можно записать:

т. е. вес арифметического среднего в n раз больше веса единичного измерения.

Аналогичным образом можно установить, что вес углового измерения, выполненного 15-секундным теодолитом, в четыре раза выше веса углового измерения, выполненного 30-секундным прибором.

При практических вычислениях обычно вес одной какой-либо величины принимают за единицу и при этом условии вычисляют веса остальных измерений. Так, в последнем примере если принять вес результата углового измерения 30-секундным теодолитом за р = 1, то весовое значение результата измерения 15-секундным теодолитом составит Р = 4.

Абсолютная погрешность — измерительный прибор

Абсолютная погрешность измерительного прибора представляет собой расхождение ( разность) между измеренным Ли и действительным ( истинным) Лд значениями измеряемой величины ДЛ — / 4н — Ац. Истинное значение измеряемой величины находят с учетом поправки. Поправка — это величина, обратная по знаку абсолютной погрешности: ДР — ДЛ Ал-А. Абсолютная погрешность электроизмерительных приборов со стрелочным показателем практически неизменна в пределах всей шкалы, поэтому с уменьшением значения измеряемой величины она возрастает. Для повышения точности измерения измеряемой величины на показывающих приборах со стрелочным указателем следует выбирать такие пределы измерения, чтобы отсчитывать показания примерно в пределах 2 / 3 всей шкалы.

Абсолютная погрешность измерительного прибора равна разности между показанием прибора и действительным ( точным) значением измеряемой величины.

Абсолютная погрешность измерительного прибора определяется разностью между показанием прибора и истинным значением измеряемой величины. Погрешность показаний прибора имеет своими источниками погрешности отдельных его элементов: чувствительного элемента, передаточного механизма и шкалы. Погрешность чувствительного элемента заключается в том, что действительная зависимость его перемещений от измеряемой величины не совпадает с расчетной, заложенной в схему прибора. Погрешность шкалы складывается из ошибки положения ее штрихов и эксцентриситета шкалы.

Абсолютной погрешностью измерительного прибора называется разность между его показанием и истинным значением измеряемой величины. Так как истинное значение измеряемой величины установить нельзя, в измерительной технике используется так называемое действительное значение, полученное с помощью образцового прибора.

Абсолютной погрешностью измерительного прибора называется разность между его показанием и истинным значением измеряемой величины. Поскольку последнее установить нельзя, то в измерительной технике используют так называемое действительное значение, полученное посредством образцового прибора.

Абсолютной погрешностью измерительного прибора называется разность между его показанием и истинным значением измеряемой величины Так как величину истинного значения измеряемой величины установить нельзя, в измерительной технике используется так называемое действительное значение, полученное с помощью образцового прибора.

Приведенная погрешность измерительного прибора — отношение абсолютной погрешности измерительного прибора к нормирующему значению, выраженное в процентах.

Корректность поставленных экспериментов доказана отсутствием превышения абсолютных ошибок измерения как при определении перемещений, так и напряжений над абсолютной погрешностью используемых измерительных приборов.

В некоторых случаях ( для образцовых и рабочих средств измерений повышенной точности) для исключения систематической погрешности показаний вводят поправку, равную абсолютной погрешности измерительного прибора.

Абсолютная погрешность измерительного прибора определяется разностью между показанием прибора и действительным значением измеряемой величины.

В данном разделе будут рассмотрены виды погрешностей, свойственные мерам, отдельным элементам и устройствам, а также средствам измерений в целом. Под абсолютной погрешностью меры понимают разность ( отклонение от номинального значения) между номинальным значением меры и истинным значением воспроизводимой ею величины. Так как истинное значение величины остается неизвестным, то на практике вместо него используют действительное значение величины. Следует различать абсолютную погрешность измерительного преобразователя по входу и по выходу. Абсолютную погрешность измерительного преобразователя по входу находят как разность между значением величины на входе преобразователя, определяемой в принципе по истинному значению величины на его выходе с помощью градуировочной характеристики, приписанной преобразователю, и истинным значением величины на входе преобразователя. Абсолютную погрешность измерительного преобразователя по выходу находят как разность между истинным значением величины на выходе преобразователя, отображающей измеряемую величину, и значением величины на выходе, определяемой в принципе по истинному значению величины на выходе с помощью градуировочной характеристики, приписанной преобразователю. Относительная погрешность измерительного прибора определяется как отношение абсолютной погрешности измерительного прибора к истинному значению измеряемой им величины.